以上代码主进程创建了两个子进程 , 子进程之间使用NCCL后端进行通信 。每个子进程各占用一个GPU资源 , 实现了所有GPU张量求和的功能 。细节注释如下:

1、为每个子进程定义相同名称的张量 , 并分别分配至不同的GPU , 从而能进行后续的GPU间通信 。

2、定义一个通信组 , 用于后面的all_reduce通信操作 。

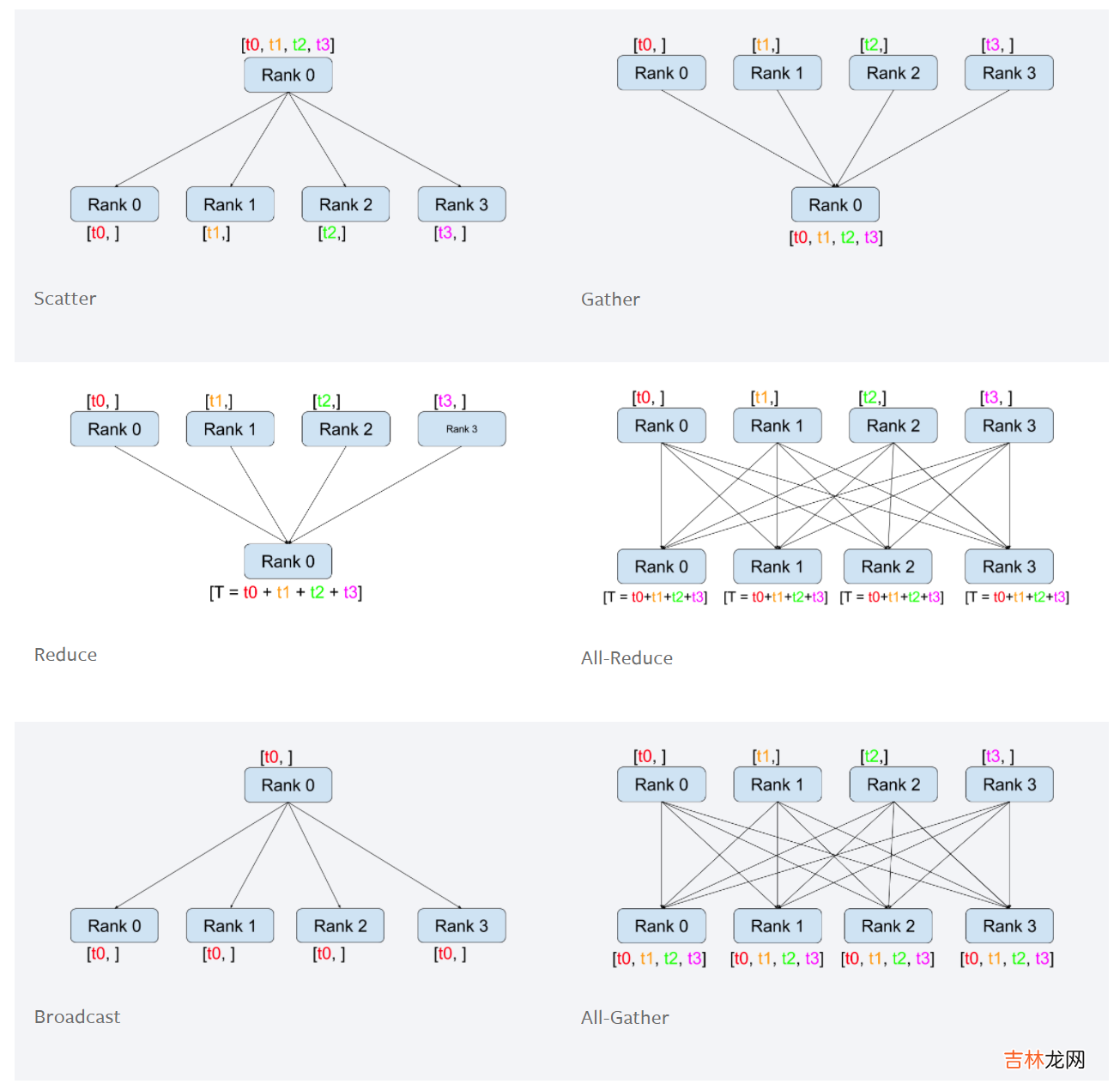

3、all_reduce操作以及其它通信方式请看下图:

文章插图

4、定义编号(rank)为0的ip和端口地址 , 让每个子进程都知道 。ip和端口地址可以随意定义 , 不冲突即可 。如果不设置 , 子进程在涉及进程通信时会出错 。

5、初始化子进程组 , 定义进程间的通信后端(还有GLOO、MPI , 只有NCCL支持GPU间通信)、子进程rank、子进程数量 。只有当该函数在size个进程中被调用时 , 各进程才会继续从这里执行下去 。这个函数统一了各子进程后续代码的开始时间 。

6、执行子进程代码 。

7、由于创建子进程会执行本程序 , 因此主进程的执行需要放在__main__里 , 防止子进程执行 。

8、开始创建子进程的方式:spawn、fork 。windows默认spawn , linux默认fork 。具体区别请百度 。

9、由于是以NCCL为通信后端的分布式训练 , 如果不同进程中相同名称的张量在同一GPU上 , 当这个张量进行进程间通信时就会出错 。为了防止出错 , 限制每张卡独占一个进程 , 每个进程独占一张卡 。这里有两张卡 , 所以最多只能创建两个进程 。

10、创建子进程 , 传入子进程的初始化方法 , 及子进程调用该方法的参数 。

11、等待子进程全部运行完毕后再退出主进程 。

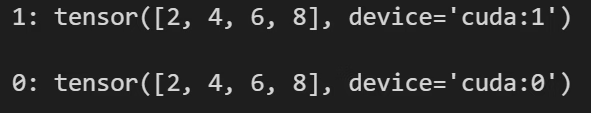

输出结果如下:

文章插图

正是各进程保存在不同GPU上的张量的广播求和(all_reduce)的结果 。

参考: https://pytorch.org/tutorials/intermediate/dist_tuto.html

Pytorch分布式训练DEMO我们实际上可以根据上面的分布式基础写一个分布式训练 , 但由于不知道pytorch如何实现GPU间模型梯度的求和 , 即官方教程中所谓的ring_reduce(没找到相关API) , 时间原因 , 就不再去搜索相关方法了 。这里仅记录pytorh内部的分布式模型训练 , 即利用DDP模块实现 。Pytorch版本1.12.1 。

import torch,osimport torch.distributed as distimport torch.multiprocessing as mpimport torch.optim as optimfrom torch.nn.parallel import DistributedDataParallel as DDPfrom torch import nndef example(rank, world_size):dist.init_process_group("nccl", rank=rank, world_size=world_size)# ——1——model = nn.Linear(2, 1, False).to(rank)if rank == 0: # ——2——model.load_state_dict(torch.load('model_weight'))# model_stat = torch.load('model_weight', {'cuda:0':'cuda:%d'%rank})#这样读取保险一点# model.load_state_dict(model_stat)opt = optim.Adam(model.parameters(), lr=0.0001) # ——3——opt_stat = torch.load('opt_weight', {'cuda:0':'cuda:%d'%rank}) # ——4——opt.load_state_dict(opt_stat) # ——5——ddp_model = DDP(model, device_ids=[rank])# ——6inp = torch.tensor([[1.,2]]).to(rank) # ——7——labels = torch.tensor([[5.]]).to(rank)outp = ddp_model(inp)loss = torch.mean((outp - labels)**2)opt.zero_grad()loss.backward() # ——8——opt.step() # ——9if rank == 0:# ——10——torch.save(model.state_dict(), 'model_weight')torch.save(opt.state_dict(), 'opt_weight')if __name__=="__main__":os.environ["MASTER_ADDR"] = "localhost"# ——11——os.environ["MASTER_PORT"] = "29500"world_size = 2mp.spawn(example, args=(world_size,), nprocs=world_size, join=True) # ——12——

经验总结扩展阅读

- AVX图像算法优化系列二: 使用AVX2指令集加速查表算法。

- 油炸回潮怎么变脆

- 单独用泡打粉发面要醒多久

- 穿久的拖鞋怎么洗干净

- 红豆煮多久才会熟

- 红曲红使用范围

- pvc桌布上的西瓜汁怎么清洗

- 蟑螂胶饵怎么使用

- 床上棉虫怎么处理

- 雅诗兰黛小棕豆怎么用?