在很多博客和知乎中我看到了许多对于pytorch框架中RNN接口的一些解析 , 但都较为浅显甚至出现一些不准确的理解 , 在这里我想阐述下我对于pytorch中RNN接口的参数的理解 。

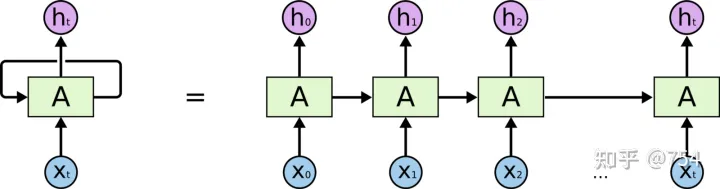

我们经常看到的RNN网络是如图下所示:

文章插图

RNN的

1. timestep训练过程这个左边图中间循环的箭头难以理解 , 所以将其按照时间轴展开成多个单元 。

但是!!!!

网络只有一个 , 网络只有一个,网络只有一个 , 并不是想右边那样画的 。右边的图只不过是不同时刻的输入 。因为每个时刻RNN会产生两个输出 , 一个output和一个state(state是输入向下一个时序的结果) , 上一个时刻state和当前作为输入给当前网络 , 就如右图所示 。上图很容易造成了误解 。

比如我们需要预测一个sin函数 , 那么我们会用x的坐标去预测y , batch

经验总结扩展阅读

- 华为手环6对比荣耀手环6哪个更值得入手?

- iQOOZ5x和iqooz5哪个好_iQOOZ5x和iqooz5区别对比

- 2023年1月18日适合出门游玩吗

- 体温计破碎用鸡蛋可以消毒吗 水银对人体有哪些危害

- 对自己的感情很迷茫的签名 对爱情不信任的签名

- 特困户补贴怎样发放

- 静态属性的陷阱 python中类与对象的命名空间、__dict__ 和 dir 在继承中使用说明

- 2021年对孩子的祝福和希望

- 有局字的四字成语

- 冬季开暖风是开内循环还是外循环