论文信息

论文标题:Rumor Detection on Social Media with Graph AdversarialContrastive Learning论文作者:Tiening Sun、Zhong Qian、Sujun Dong论文来源:2022, WWW论文地址:download论文代码:downloadAbstract尽管基于GNN的方法在谣言检测领域取得了一些成功,但是这些基于交叉熵损失的方法常常导致泛化能力差,并且缺乏对一些带有噪声的或者对抗性的样本的鲁棒性,尤其是一些恶意谣言 。有时,仅仅设置一个简单的扰动就会导致标签被高度置信地错误分类,这对谣言分类系统无疑是一个巨大的潜在危害 。因此,现有的数据驱动模型需要变得更加健壮,以应对通常由正常用户无意识地产生和传播的错误信息或者由谣言制造者恶意设计的混乱对话结构 。

在本文中,我们提出了一种新的图对抗对比学习(GACL)方法来对抗这些复杂的情况,其中引入对比学习作为损失函数的一部分,用于明确感知同类和不同类的会话线程之间的差异 。同时,设计了一个对抗性特征变换(AFT)模块来产生相互冲突的样本,以加压模型以挖掘事件不变的特征 。这些对抗性样本也被用作对比学习的硬负样本,使模型更鲁棒和有效 。在三个公共基准数据集上的实验结果表明,我们的 GACL 方法比其他最先进的模型取得了更好的结果 。

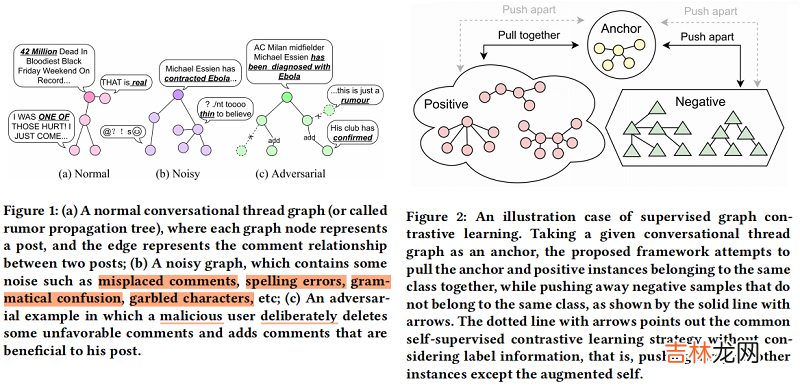

1 Introduction本文提出一个图对抗对比学习(GACL)方法谣言检测 。具体来说,首先采用 edge perturbation 和 dropout 等图数据增强策略掩模来模拟 Figure 1(b) 的情况,它为模型提供了丰富噪声的输入数据 。然后,我们引入 Figure 2 所示的监督图对比学习 来训练 GNN 编码器 明确地感知增强数据的差异,并学习鲁棒表示 。与自监督对比学习策略不同,本文的方法可以更有效地利用标签信息 。这样,就可以防止在一些包含噪声的情况下,如错误的注释和混乱的字符被检测模型错误地分类 。

文章插图

有时,仅凭这一点是不够的 。因为在现实世界中,除了由普通用户无意中创造和传播的错误信息外,还有一些由谣言生产者精心设计和故意推广的恶意谣言,如 Figure 1(c) 所示,这可能会使该模型失效 。一些研究人员也注意到了这个问题 。Ma等人[21]分析了一个关于“沙特阿拉伯斩首第一个女性机器人公民”的谣言案例,以说明谣言机器人如何使用高频和指示性词汇来掩盖事实 。Yang等人 [32] 还提到,谣言生产者经常操纵由用户、消息来源和评论组成的关系网络,以逃避检测 。无论是文本篡改还是网络操纵,谣言制作者的目的都是使谣言在高维空间中接近非谣言样本,从而混淆模型 。因此,为了解决这个问题,我们开发了一个对抗性特征转换(AFT)模块,旨在利用对抗性训练来生成具有挑战性的特征 。这些对抗性特征将作为对比学习中的硬负样本,帮助模型加强对这些困难样本的特征学习,实现鲁棒性和有效的检测 。此外,我们直观地相信,这些对抗性的特征可以被解码成各种不同类型的扰动 。

本文贡献:

- 据我们所知,这是第一个将对比学习引入谣言检测任务的研究,旨在通过感知同一标签和不同标签样本之间的差异来提高表征质量 。

- 我们提出了GACL模型,它不仅考虑了谣言的传播结构信息,还模拟了噪声和对抗性情况,并利用对比学习捕获了事件不变特征 。

- 在GACL框架下,我们开发了AFT模块来生成对抗性特征,这些特征作为对比学习中的硬负样本,以学习更鲁棒的表示 。

- 我们通过实验证明,我们的模型在真实世界的数据集上优于最先进的基线 。

经验总结扩展阅读

- 非典为什么只感染华人?

- 吃鸡怎么举报100让对方被检测?

- 水质检测到哪里

- 安检门能检测什么东西

- 口罩如何检测是否合格

- 标致308电脑检测口在哪里?

- 比亚迪s6检测不到钥匙怎么办?

- 胶金体检测是什么意思

- 核酸检测阴性是指什么

- 胶体金检测什么意思